Apple hat eine Reihe umfangreicher Maßnahmen zum Schutz von Kindern vor sexueller Ausbeutung und Belästigung angekündigt. Diese setzen samt und sonders auf künstliche Intelligenz und sollen später für iOS 15 und macOS Monterey als Updates ausgerollt werden.

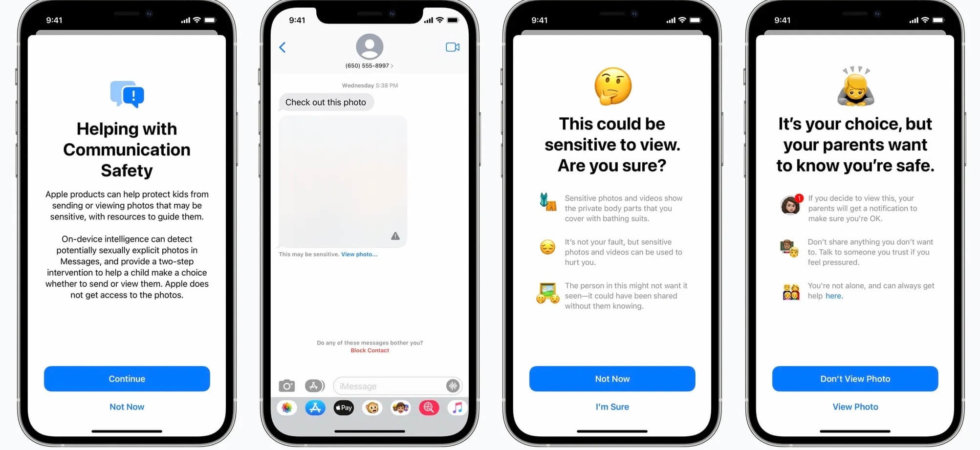

Apple möchte Kinder besser vor sexueller Belästigung schützen. Zu diesem Zweck hat das Unternehmen eine neue Initiative vorgestellt, die eine Reihe von Maßnahmen umfasst. Diese setzen bereits bei iMessage an: Erhalten Kinder hier ein Bild mit sexuellen Abbildungen, wird es zunächst nur unscharf dargestellt. Ein Dialog informiert den Empfänger überdies darüber, dass das Bild sensible Motive beinhaltet. Kinder können sich aber dennoch dafür entscheiden, das Bild anzuzeigen, das wird dann allerdings auch den Eltern angezeigt, worüber die Kinder wiederum ebenfalls informiert werden.

Auch das Versenden sexuell expliziter Bilder wird zunächst mit einer entsprechenden Benachrichtigung gebremst, auch diese kann übersprungen werden, was dann ebenfalls eine Nachricht an die Eltern auslöst. Das setzt voraus, dass die Kinder und Eltern in der selben iCloud-Familie angemeldet sind.

Automatische Suche nach sexuellen Übergriffen

Sehr viel weitreichender ist indes ein neuer Ansatz, der verhindern soll, dass Kinder sexuell ausgebeutet werden. Hierbei wird automatisch nach Fotos auf den Geräten von Nutzern gesucht, die sexuelle Handlungen an Kindern zeigen. Hierfür nutzt Apple eine der Photo DNA vergleichbare Technik, die Microsoft schon seit Jahren einsetzt, doch Apple hat hier einen Ansatz implementiert, der den Datenschutz der Nutzer sicherstellen soll.

Der Abgleich erfolgt rein lokal auf den Geräten der Nutzer und erfolgt anonymisiert. Als Referenz herangezogen wird hierzu eine Datenbank, die beim amerikanischen National Center for Missing and Exploited Children geführt wird. Sollte eine Übereinstimmung gefunden werden, arbeitet Apple mit einem Schwellenwert, dessen Zusammensetzung einer recht komplexen und wenig durchsichtigen Systematik folgt. Unterhalb des Schwellenwert passiert nichts, wird er jedoch überschritten, prüft ein Mitarbeiter bei Apple den Vorgang und die Apple-ID des Kunden wird deaktiviert, zugleich geht eine Meldung an die Behörden.

Der Kunde kann ein Missverständnis geltend machen und gegen die Accountschließung vorgehen, Apple spricht jedoch von einem extrem sicheren Verfahren. Die neuen Funktionen werden später im Jahr für iOS 15 und macOS Monterey ausgerollt und starten zunächst in den USA.

Ob und wann die Features in weitere Länder kommen, bleibt noch offen.

Vorherige Artikel

Vorherige Artikel Nächster Artikel

Nächster Artikel